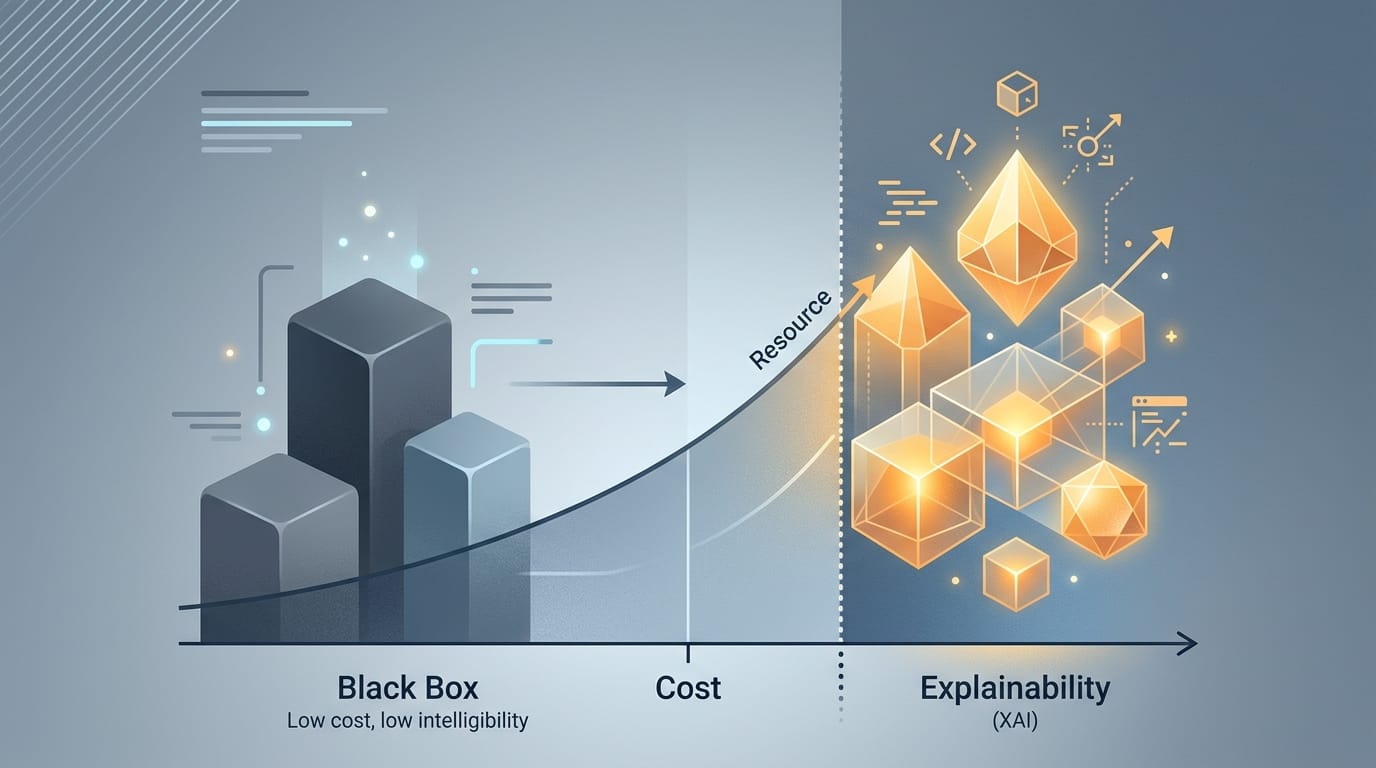

組合式推理的成本邊界:何時該從黑盒升級到可解釋性

組合式推理能超越黑盒基線,但成本邊界在哪裡?論文提示了一個工程決策框架:何時人機協作的迭代分解值得投入。

端到端還是分解推理,不是技術選擇題

過去幾年,我們習慣了一個假設:大語言模型越大越好,end-to-end 的黑盒推理最簡單最高效。但 Iterated Decomposition 這篇論文挑戰了這個想法——不是透過更大的模型,而是透過把推理過程分解成可檢驗的組件,然後人機協作逐步精化。

重點不在論文本身有多聰明,而在於它問了一個工程團隊真正關心的問題:什麼時候這種複雜的 workflow 才值得投入?

從「模型不行」到「這一步不行」

傳統的 LM 除錯很粗糙。模型輸出錯誤答案,你的選擇就是調 prompt、加訓練資料、或重新訓練。整個系統是黑盒,你看不到推理過程中哪裡出了問題。

組合式推理改變了這個遊戲。當推理被分解成多個步驟——「理解題目」→「檢索相關知識」→「組合推理」→「生成答案」——你突然有了診斷的能力。失敗的案例可以追蹤到具體是哪個組件搞砸了。

論文提到的「zoom in on failing components」就是這個意思。你不是在調整整個模型,而是在修復特定的推理步驟。也許第三步的 chain-of-thought 需要加強,也許第一步需要更多 context。這種精度對工程團隊的價值很大——你知道改什麼,而不是盲目試錯。

基礎設施成本和人力成本的平衡

但這裡有個隱藏的代價:論文用的是 ICE(Interactive Composite Explanations)這套工具,需要人工介入迭代流程。每一次「精化某個組件」都可能涉及手動調整、測試、驗證。

什麼時候這種投入才划算?

假設你的科學 Q&A 系統現在用端到端 LM,準確率 70%。升級到組合式推理可能能達到 85%,但需要建立推理分解的基礎設施(可能需要幾周的工程工作),每個新的推理路徑都需要人工驗證和優化,以及維護多個組件而不是一個黑盒。

在什麼規模下這些成本才被攤薄掉?論文沒有直接回答,但暗示了一個事實:如果你的問題域足夠穩定、錯誤案例足夠集中,手動優化每個組件的回報率會很高。但如果你面對的是開放領域、問題不斷變化,這套方法可能就變成了無止盡的優化黑洞。

自動化邊界在哪裡

論文有句話很關鍵:「if automated, could keep ML systems interpretable」。這暗示當前的迭代分解還是半手動的。人在迴圈裡,識別瓶頸、調整組件、驗證改進。

什麼時候應該停止手動優化?邊際效益遞減會很快出現。第一輪優化可能從 70% 提升到 80%,第二輪到 83%,第三輪到 84.5%。每一輪投入的人力成本是差不多的,但收益在下降。在某個點,你必須做出選擇:繼續手動精化,投入更多人力換取 1-2% 的提升;接受目前的性能,轉向其他優化方向(比如資料質量、評估框架);或投資自動化,讓系統自己學會優化組件。

論文沒有提供清晰的決策框架,但它至少讓你能夠量化這個決策。你可以追蹤每個迭代輪次的成本和收益,而不是在黑盒裡猜測。

實務上的判斷

組合式推理值得投入,但前提是你能清楚地定義「失敗」的類型。如果你的錯誤案例可以分類成 3-5 種根本原因,每種都對應到推理流程的某個組件,那麼這套方法會有很高的 ROI。

反之,如果錯誤是散亂的、難以追蹤到具體組件,手動優化會變成一場消耗戰。那時候你應該考慮改進資料、重新設計問題分類、或接受目前的準確率。

關鍵是不要被「可解釋性」迷惑。可解釋性是一個副產品,真正的價值在於能夠精準診斷和有針對性地優化。如果你無法把診斷轉化成實際改進,可解釋性本身就只是好看。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。