模型不是越大越聰明,而是我們把太多髒記憶塞進了它

當我們把模型規模視為智能程度,往往也忽略了一件更根本的事:很多參數可能不是在負責推理,而是在替破碎資料做壓縮、替混亂世界做記憶。下一代 AI 系統的關鍵,也許不是更大的模型,而是更清楚的認知與記憶分工。

最近重新整理這個題目時,我更強烈地感受到:我們一直拿模型大小當成智能指標,卻很少追問那些被塞進參數裡的東西,到底有多少其實只是雜訊管理。

如果這個前提成立,很多看似模型能力的競賽,最後都會回到系統分工與記憶設計。

這個說法之所以重要,不只是因為它反直覺,而是因為它會直接改變我們怎麼理解 AI 系統設計。

很多人看到 frontier model 動輒幾千億、上兆參數,第一反應通常是:任務太難了,所以模型一定得這麼大。但如果反過來看,事情可能完全不同。

模型變大,不一定是因為推理更複雜;也可能是因為資料更髒、語境更亂、世界本身太破碎。

換句話說,很多參數消耗的不是認知成本,而是清理成本。

如果這個判斷成立,那我們過去對模型規模的崇拜,就值得重新檢查。

一個更值得思考的切分方式

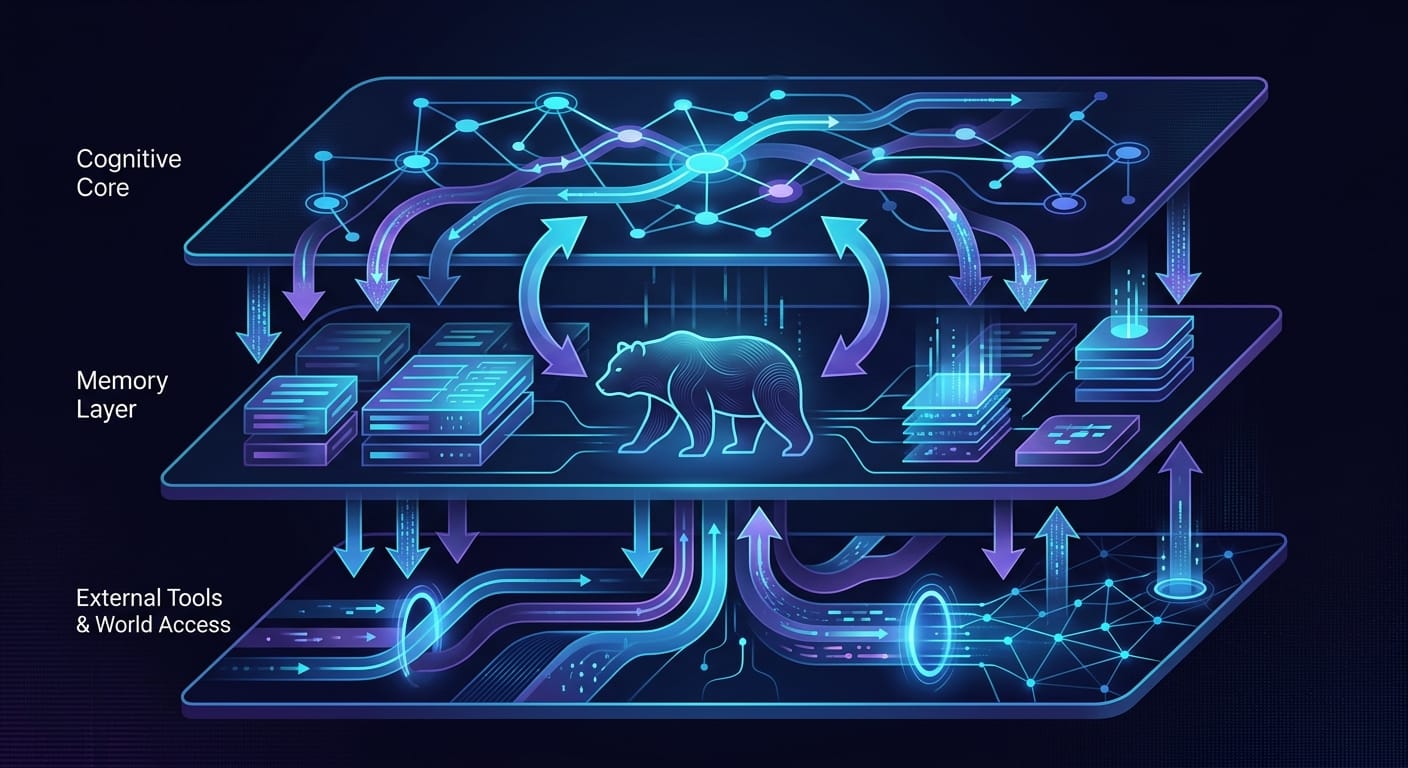

AI 系統中的認知核心、記憶層與工具層分工示意

我現在越來越傾向把 AI 系統拆成三層來看:

- 認知核心:負責抽象、推理、判斷、規則遷移。

- 記憶層:負責保留事實、上下文、歷史狀態、長期知識。

- 工具/檢索層:負責從外部世界即時取用資料,補足模型內部記憶的限制。

真正昂貴的,不一定是第一層。很多時候,真正把系統撐大的,是第二層與第三層混在一起,最後全部被塞進模型權重裡。

這也是為什麼今天很多模型看起來很強,卻又常常顯得笨重。它們像一個被迫同時擔任推理者、圖書館、備忘錄、檔案倉庫的系統。能做很多事,但成本極高,也很難優雅。

我們過去錯把「記得很多」當成「理解很多」

這幾年模型能力快速進步,讓人很容易產生一種錯覺:參數越大,智慧越高。

但更準確的說法可能是:參數越大,代表它越有能力在一團混亂裡保留可用訊號。

這不是沒有價值,事實上,這非常有價值。只是它提醒我們,模型規模未必是智慧的直接指標,更像是對現有資料品質與系統設計粗糙度的一種補償。

當訓練資料充滿 broken HTML、碎片語句、垃圾內容、低密度資訊時,模型就得用更大的容量去吸收與壓縮。所以我們看到的,也許不是一顆越來越會思考的大腦,而是一台越來越能吞噪音的壓縮引擎。

下一代架構競爭,可能不在模型大小,而在責任分離

我覺得真正值得關注的,不是大模型會不會被小模型取代,而是我們是否正在進入一個新的架構階段:把認知核心,從記憶與資料儲存責任中解放出來。

這意味著未來的 AI 系統,可能不是一個萬能單體,而是更像一組協作良好的組件:

- 小而強的認知核心,負責思考與決策

- 結構化記憶系統,負責狀態與長期知識

- RAG / search / tool use,負責連接外部世界

- workflow orchestration,負責在任務層整合它們

如果是這樣,那 AI 工程的重心就會再次轉移。

我們不再只是比誰能把模型做得更大,而是比誰更能把「什麼該記住、什麼該外包、什麼該即時取得」這件事設計清楚。

這其實也是我最近越來越強烈的感受:很多看起來像模型能力的問題,本質上其實是系統分工問題。

真正值得追求的,也許不是無止境地擴張模型,而是重新安排認知、記憶與工具之間的責任邊界。

結語

當我們把模型看成一個必須包辦一切的黑盒子,就很容易誤以為更大就是更聰明。但如果把它放回系統脈絡裡看,會發現更大的模型,有時只是替一個設計不夠乾淨的世界收拾殘局。

當這條邊界被畫清楚,模型才有可能真正變得更輕、更準,也更像一個可以長期協作的系統核心。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。