記憶管理可能比向量資料庫更值得優化

內建記憶管理可能比向量資料庫更適合某些應用場景——成本更直觀,複雜度更低,關鍵是問對問題。

問題的另一個角度

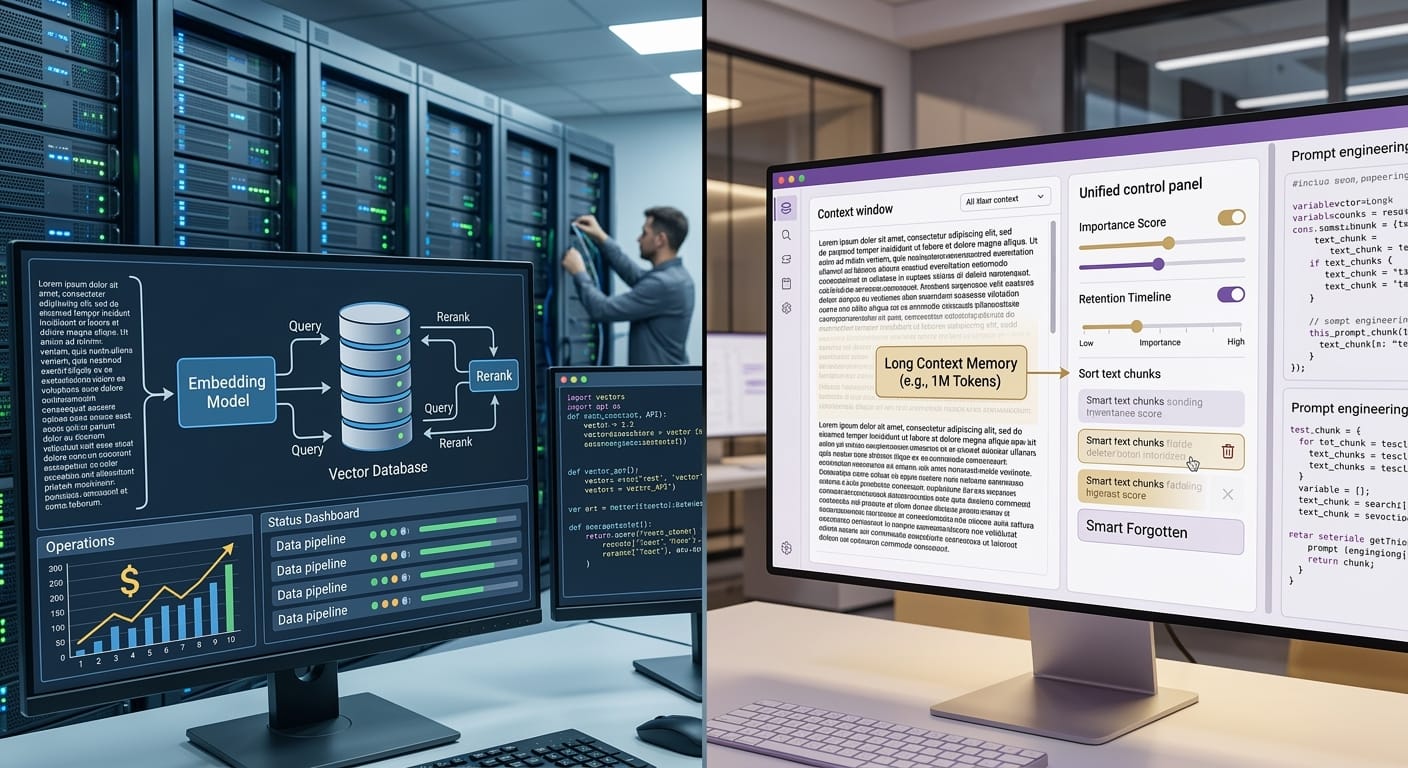

在 RAG 系統裡,我們習慣性地把記憶外包給向量資料庫。embedding、檢索、重排——整套工具鏈已經成熟到不需要多想。但 MeowCoder 提出了一個值得認真對待的觀點:如果 LLM 本身可以內建記憶管理,我們對這套基礎設施的依賴是不是被高估了?

這不是說向量資料庫沒用。而是說,我們可能把問題框錯了。

LLM 內建記憶的實際意義

現在的 LLM 可以在上下文裡維持相當長的信息鏈。如果系統能夠聰明地管理這些上下文——決定什麼時候保留、什麼時候遺忘、什麼時候主動喚起——那麼你就有了一個記憶系統,不需要向量化。

這有幾個實際的好處:

- 成本直觀——你付的是 token 費用,而不是向量資料庫的查詢和維護成本。成本和效果的對應關係更清晰。

- 一致性更好——資訊不經過 embedding 和檢索的轉換,語義損失更少。模型看到的就是原始文本。

- 系統複雜度更低——少一個外部依賴,就少一個可能出錯的地方。

什麼時候這個方向有意義

不是所有場景都適合這樣做。如果你的記憶量超過模型的有效上下文窗口,或者檢索的精度要求極高,向量資料庫還是必要的。

但在很多實際的應用裡——比如多輪對話、個人助手、內部工具——記憶量其實沒那麼大。你真正需要的是一個聰明的遺忘機制和上下文管理策略。在這些場景裡,內建記憶可能反而更高效。

關鍵是要問對問題:我真的需要全局檢索嗎?還是我只需要在當前對話的脈絡裡保持連貫?

現在值得試

這個方向現在變得可行,主要是因為上下文窗口在擴大,而且 LLM 對長文本的理解能力在改善。如果你還在用向量資料庫但沒有仔細計算過它的成本和效果,不妨試試看用 prompt 工程和記憶管理策略來替代部分功能。

不一定能全部替代。但可能會發現,你原本以為必需的東西,其實是為了解決一個不存在的問題。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。