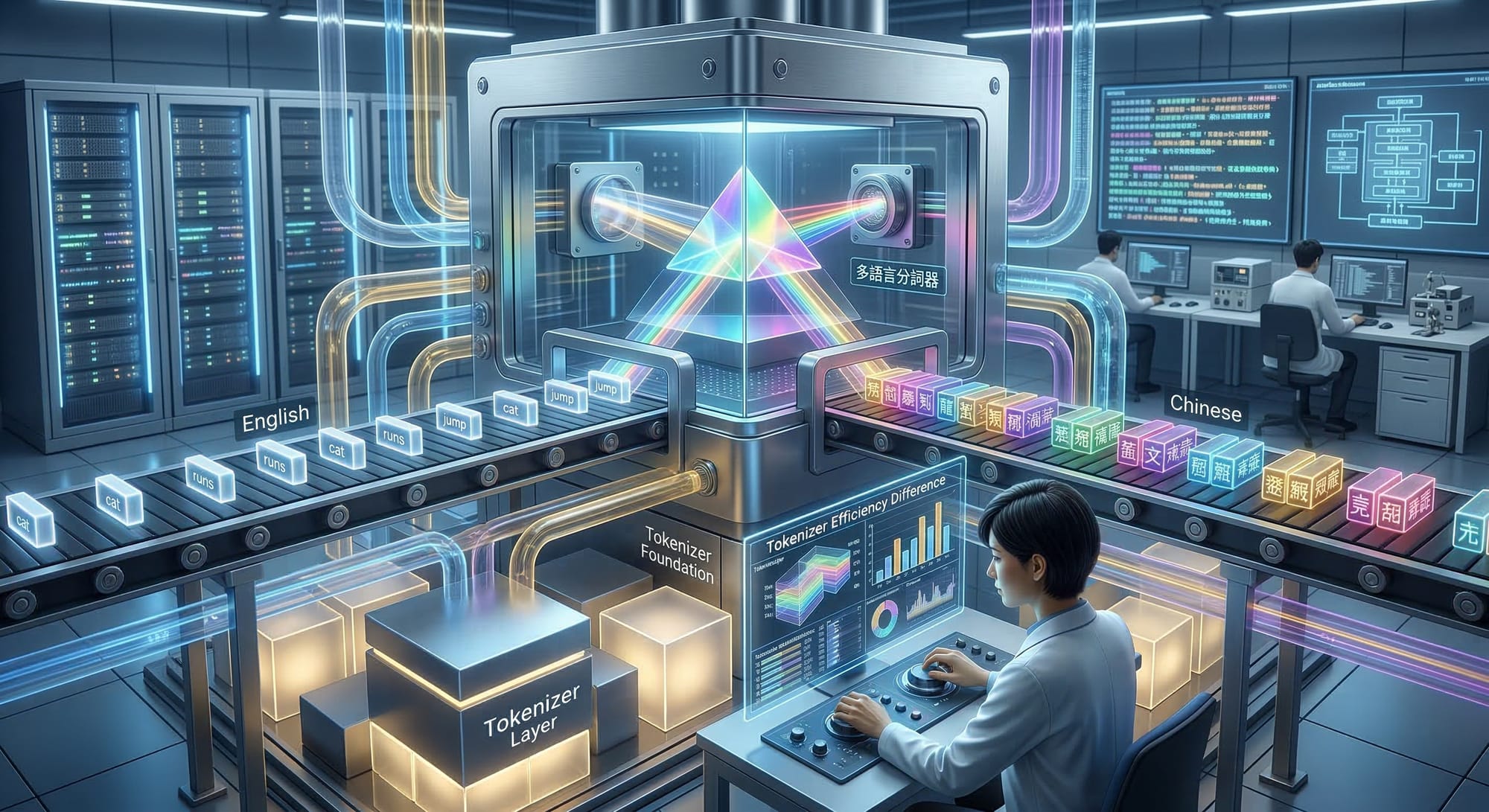

多語言模型的真正瓶頸在 tokenizer,不在模型本身

多語言模型的性能差異,根本原因不在資料量或架構,而在於 tokenization 效率的語言差異——這是一個被長期忽視的瓶頸。

問題藏在最底層

我們習慣把多語言模型的性能差異歸因於訓練資料不足或架構設計,但 MeowCoder 的觀察指向一個更基礎的地方:tokenization。

這個觀點值得認真對待。因為 tokenizer 是模型和文本之間的唯一介面。你的資料再豐富、架構再精妙,一旦 tokenization 效率低下,整個系統就被拖累了。

為什麼 tokenizer 會成為瓶頸

英文和中文的 tokenization 效率差異巨大。英文單詞平均 4-5 個字符對應 1 個 token,中文每個字符往往需要 1-2 個 token。這不只是數字上的差異。

- 序列長度膨脹:同樣的語義內容,中文需要更多 token 來表達。這直接增加了計算成本和上下文壓力。

- 語義邊界破裂:當詞被拆成多個 token,模型需要額外的層數才能重新組合語義。這是隱形的複雜度。

- 訓練效率下降:相同的 token 預算下,多語言模型能看到的實際文本量更少。資料利用率本身就打折扣。

這不是新問題,但被忽視了

多語言 tokenizer 的優化空間其實很大,但大多數工作還在停留在「加大詞表」的老思路。真正的改進方向應該是:

- 針對特定語言對的混合 tokenizer 設計

- 動態 token 長度,而不是固定的 subword 切分

- 在訓練階段就考慮多語言的 token 效率差異

但這些方向都需要重新思考 tokenization 的本質,而不是在現有框架上修修補補。

實務上的含義

如果你在做多語言模型優化,在投入更多資料或調整架構之前,先檢視 tokenizer。問自己:

- 中文文本的平均 token 長度是英文的幾倍?

- 這個差異會如何影響你的上下文窗口利用率?

- 有沒有可能通過更好的 tokenization 獲得 10-20% 的性能提升?

往往答案是有的。而且這個改進的投資回報率,可能遠高於堆砌資料或參數。

這也提醒我們一個更大的原則:性能瓶頸經常不在你最關注的地方。真正的優化往往需要往下挖一層,找到那些被當作「已解決」但其實還有巨大改進空間的基礎設施。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。