超長 Context 不是萬靈丹:MIT 提醒我們小心「Context Rot」

最近看到一個很典型的科技流量標題:

「別再迷信超長 context 了!救星竟然是 Python?」

標題很會抓眼球,但我更在意的是它背後那個更實際的訊息:你把更多文字塞進模型,不等於模型就更懂你要它做什麼。

## 「超長 context」的幻想:把整本書丟進去就能推理

很多產品在推長 context 時,大家腦中想像的使用情境往往是:

- 把一堆文件丟進去

- 然後要求模型做跨段落、跨頁碼、跨章節的推理

- 最後得到一個精準可追溯的答案

但這裡有一個被忽略的現實:Transformer 的注意力機制對「資訊量」很敏感,你越塞越多,模型越容易把關鍵線索當成噪音。

MIT 這類研究(或你在實務中做的長文件 QA)常會遇到一種現象:

- 單點查找還行

- 一旦需要跨段落組合、比對、推理,表現會明顯崩掉

社群把它稱為 Context Rot(上下文腐爛):context 變長,理解能力沒有等比例提升,反而像在一堆紙堆裡找針。

## 真正該問的問題:你要的是「讀得多」還是「做得對」

我覺得很多團隊會在兩個方向卡住:

- 把長 context 當成能力本體:以為 window 變大就等於模型變聰明。

- 忽略任務型態差異:不同任務需要的不是更多文字,而是更好的組織方式。

如果你的需求是「跨段落關聯推理」,你最需要的通常是:

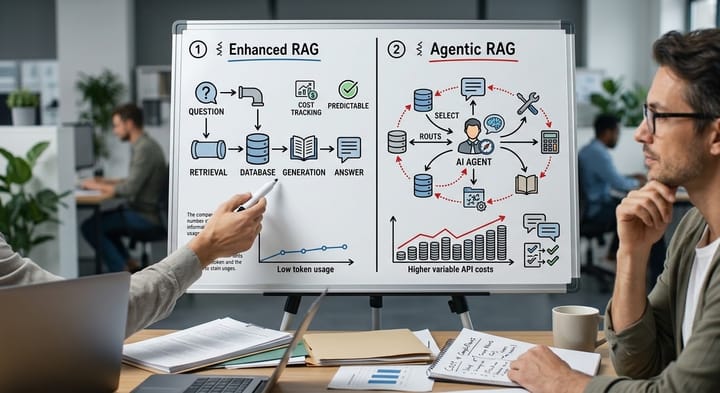

- 可靠的檢索與切分(retrieval + chunking)

- 明確的證據鏈(citations / evidence tracing)

- 任務分解(先找候選,再做比對,再下結論)

而不是一口氣把整本書塞滿。

## 「Python 是救星」的真意:把推理搬到模型外

我猜這種貼文講的「RLM 架構」想表達的方向,核心大概是:

- 模型負責語意理解與生成

- 真正需要嚴謹的計算、匹配、圖搜尋、去重、排序、驗證,交給外部程式(例如 Python)

這在工程上很合理。

因為你越期待模型在長 context 裡做「精準比對」,它越容易:

- 找錯段落

- 忘記前面條件

- 把相近的概念混在一起

- 給你一個看似合理但無法驗證的答案

把部分推理改成可驗證的程式步驟,你得到的是可控性,而不是祈禱。

## 給做 AI 產品的人:不要把長 context 當成護城河

長 context 會是一個產品賣點,但它很少是完整解法。

如果你真的在做長文件、企業知識庫、法務合約、研究報告這些場景,我會把重心放在三件事:

- 把「找資料」系統化:檢索、索引、權重、分段策略。

- 把「證據」標準化:回答必須附引用,引用必須可點回原文。

- 把「推理」流程化:先縮小範圍,再做關聯推理,再做一致性檢查。

模型再強,沒有流程與外部工具,長 context 很容易變成「看起來很猛,但用起來不穩」。

## 結尾

我不會說「別再迷信長 context」這句話是錯的,它只是太粗暴。

比較精準的說法是:長 context 是容量,不是智力。

你可以把更多文字放進去,但你仍然需要一套方法,讓模型知道什麼重要、什麼要比對、什麼要驗證。

#LLM #RAG #ContextWindow #AI產品 #PromptEngineering #Transformer