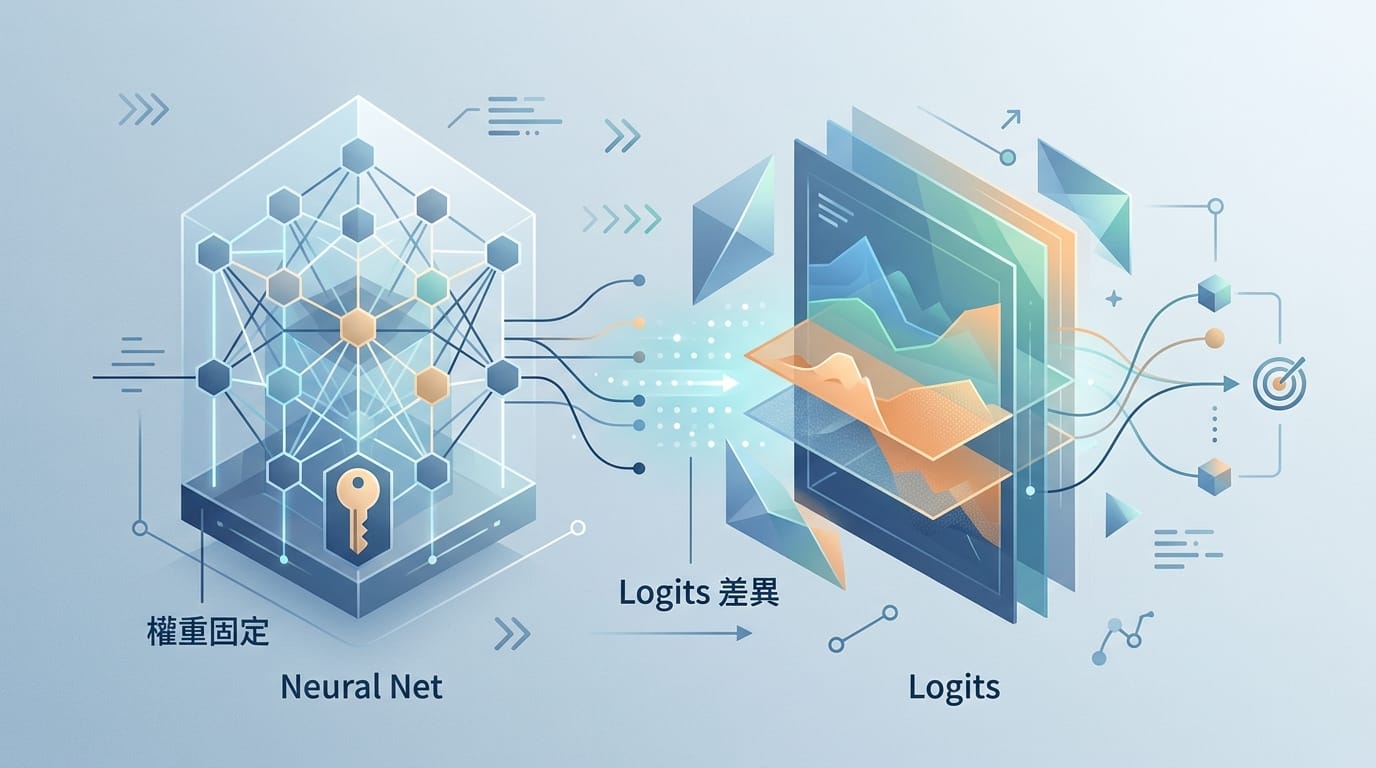

不改權重也能微調,logits 差異法的實用意義

logits 差異法用小模型學習微調偏差,讓多個輕量適配器共用同一個基礎模型,但推理延遲翻倍的代價需要認真評估。

權重凍結微調的真正問題

傳統微調 LLM 的成本主要不在計算,而在部署。一旦微調,你得存儲新的權重檔案、管理版本、在推理時切換模型。如果要對同一個基礎模型做多個微調版本(不同任務、不同領域、不同客戶),複雜度會線性增長。

Sebastian Raschka 提到的這個方法試圖繞過這個問題:不動原模型的權重,只保存一個小模型的 logits 差異。

logits 差異法的邏輯

概念很直接:

- 基礎模型推理時輸出 logits(未經 softmax 的原始分數)

- 小模型學習「微調後的 logits 應該比基礎 logits 差多少」

- 推理時,用小模型預測差異,疊加到基礎 logits 上

這樣做的好處顯而易見:小模型的參數量可能只有基礎模型的 1-5%,存儲成本大幅下降。而且多個微調任務可以共用同一個基礎模型,只需要切換不同的小模型。

我關心的是實用細節

論文或推文通常只說「效能接近全量微調」,但沒講清楚的是:

延遲成本。推理時需要先跑一次基礎模型,再跑一次小模型,再做 logits 融合。這是兩次前向傳播。在端到端延遲敏感的場景(比如對話系統),這可能抵消掉存儲省下來的收益。

小模型的設計空間。小模型怎麼設計?它是簡單的線性層,還是有幾層 transformer?不同設計下,學習曲線和最終效能會差很多。我沒看到有系統的對比。

多任務干擾。如果基礎模型被多個小模型同時用,它們會互相影響嗎?或者基礎模型的 logits 分佈本身會因為不同小模型的訓練而漂移?

什麼場景下值得試

如果你的瓶頸確實是存儲和版本管理,而不是延遲,這個方向有意義。比如:

- 邊界設備部署,基礎模型固定,只需要輕量級微調適配

- 多客戶 SaaS,每個客戶一個小模型,共享基礎模型基礎設施

但如果延遲本身就是約束條件,兩次前向傳播可能是致命傷。

這不是新技術本身有問題,而是:每個優化都在交換什麼。這個方法交換的是推理速度換存儲效率。值不值得,得看你的實際約束。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。