AI 圈內人 vs 大眾:50% 認知落差,會在組織裡變成什麼?(Stanford AI Index 2026)

Stanford AI Index 2026 量化了 AI 專家與大眾對就業的 50% 認知落差。這不是網路吵架,而是企業導入 AI 時最常被低估的摩擦力:採用率、信任與風險治理。

在 AI 圈內工作的人,常把「效率提升」視為已發生的事;但多數民眾感受到的卻是「工作被取代」與「監管不可信」。這種落差不是社群吵架用的話題,而是企業落地 AI 時最常被低估的摩擦力:同一套系統,上線後能不能被用、能不能被信、會不會引發反彈。

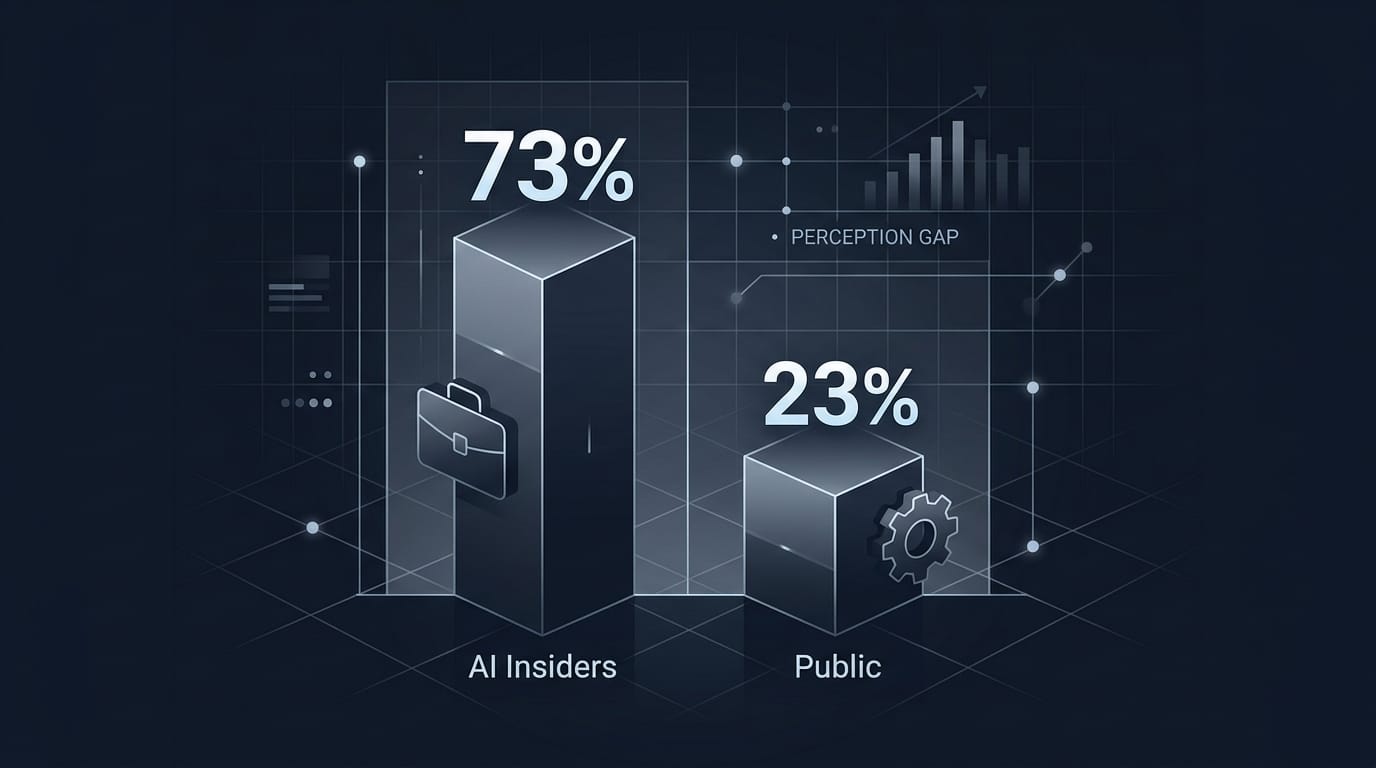

Stanford 的 2026 AI Index 報告把這件事量化了:專家與大眾在「AI 對就業是好是壞」的看法差距,已經大到足以改變企業推進節奏與政策風險。

TL;DR:AI 專家對就業更樂觀、民眾更悲觀,差距達 50 個百分點;同時入門層職缺下滑等訊號,表示職能結構正在重排,企業需要用「信任工程」把技術潛力轉成可持續的生產力。

一個 50% 的認知落差,會在組織裡變成 100 個小阻力

報告指出,73% 的美國 AI 專家認為 AI 對就業有正面影響,但只有 23% 的普通民眾同意,落差高達 50 個百分點。這個數字的含義很直接:當你在內部推 Copilot、推自動化流程、推智能客服時,反對聲音很可能不是「反技術」,而是「不相信這會對我有利」。

在產品/工程落地上,這會表現在三個地方:採用率低、迴避使用、以及把風險放大成輿論議題(尤其當組織過去缺乏透明溝通時)。

入門職缺下滑不是恐慌材料,是職能重組的早期訊號

素材提到:25 歲以下的軟體開發職缺自 2022 年起下降近 20%。這種變化值得關注,因為「入門層」是產業補血與人才梯隊的入口。當入口變窄,組織會出現兩個後果:

- 中高階工程師被迫承擔更多原本由初階處理的工作(或被迫把工作拆解後交給模型/工具)

- 招募策略從「潛力」轉向「立即能打」,進一步拉大新手的難度

如果你是企業決策者,該看的不是「AI 會不會取代工程師」這種二選一,而是:哪些工作項被自動化、哪些能力變成新的門檻、如何讓人才培養路徑不斷掉。

生產力提升是真的,但「可用性證據」要跟上,特別是醫療

素材整理的數據顯示,AI 帶來的生產力提升在客服與軟體開發領域約 14–26%;醫療端甚至出現「病歷書寫時間最多下降 83%」的案例。這些結果令人興奮,但同一份整理也提醒:超過半數臨床 AI 研究仍偏向「考題式問答」,而不是以真實患者資料與臨床流程做嚴格驗證。

落地角度看,這等於在提醒我們:Demo 能跑、benchmark 能高分,距離「臨床可用」仍有一段需要補齊的證據鏈。尤其在高風險領域,驗證方法與報告標準本身,就是產品的一部分。

信任不是公關,是可以被設計與交付的系統能力

素材提到,美國民眾對政府能負責任監管 AI 的信任度僅 31%,在受訪國中最低。企業即使不是監管者,也會被員工與使用者要求回答同一套問題:資料怎麼用、出錯怎麼處理、模型偏差怎麼監控、誰負責。

這時候,最有效的做法往往不是「講願景」,而是把風險管理做成可檢視、可追溯、可回滾的機制(例如依 NIST AI RMF 這類框架建立內控語言與流程),讓信任能落在日常操作上。

Checklist:企業要縮短認知落差,可以先做的 8 件事

- 針對「員工會被影響的工作項」做清單:哪些會自動化、哪些會強化、哪些會重組

- 把導入目標寫成可驗證指標(例:回覆時間、缺陷率、交付週期),避免只談「更智慧」

- 為高風險場景建立「人類覆核」與「升級路徑」:何時必須人工介入、誰是最後責任人

- 做到可追溯:提示詞/版本/資料來源/輸出結果的紀錄與稽核機制

- 提供角色化訓練:工程、客服、法務、營運,各自需要的使用邊界不同

- 設計回饋迴路:讓一線能回報誤判、幻覺、偏差案例,並進入修正排程

- 公開「不能做什麼」:禁用情境與紅線,比空泛承諾更能降低焦慮

- 內部先建立可信示範:先在可控範圍做出明顯收益,再擴大覆蓋面

Q&A:初階工程師現在該怎麼看這波變化?

Q:入門職缺下降,代表「學程式沒用了」嗎?

A:比較務實的解讀是:入門工作的內容正在被重切。你需要更快跨過「可被工具替代的部分」,把時間投入到需求拆解、系統整合、測試策略、資料品質、以及把 AI 產出變成可維運交付物的能力。

Q:企業該怎麼避免新手斷層?

A:把 AI 當成「教練與工具鏈」,不是當成「省略培訓」的理由。可用 pair programming + code review + 內部 playbook,把新手能產出的交付物重新定義,讓成長曲線變陡而不是被砍掉。

可引用原則句(可放在簡報或內部共識文件):

- 「認知落差會直接反映在採用率上;採用率不高,再好的模型也只是展示品。」

- 「在高風險領域,benchmark 不是驗收;可追溯、可稽核、可回滾才是可用性的底線。」

參考來源:

- Stanford HAI, AI Index 2026 Report:https://hai.stanford.edu/ai-index/2026-ai-index-report

- TechCrunch 報導:https://techcrunch.com/2026/04/13/stanford-report-highlights-growing-disconnect-between-ai-insiders-and-everyone-else/

- Stanford HAI, 12 takeaways:https://hai.stanford.edu/news/inside-the-ai-index-12-takeaways-from-the-2026-report

- NIST, AI RMF 1.0:https://www.nist.gov/itl/ai-risk-management-framework

- BMJ, CONSORT-AI:https://www.bmj.com/content/370/bmj.m3164

#AI #AIIndex #產品管理 #工程管理 #職涯與技能 #醫療AI #AI治理

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。