AI 工具的實用性瓶頸不在模型,在工程框架

AI 工具的實用性不取決於模型能力的絕對值,而取決於工程框架怎麼組織這些能力。

模型能力和工程框架的錯位

Claude Code 最近的更新引發了一些討論。有人說它「越獄」了,有人說它獲得了「永生」。這些說法背後反映的是一個觀察:我們經常把 AI 工具的能力邊界和它在實際應用中能發揮多少作用混為一談。

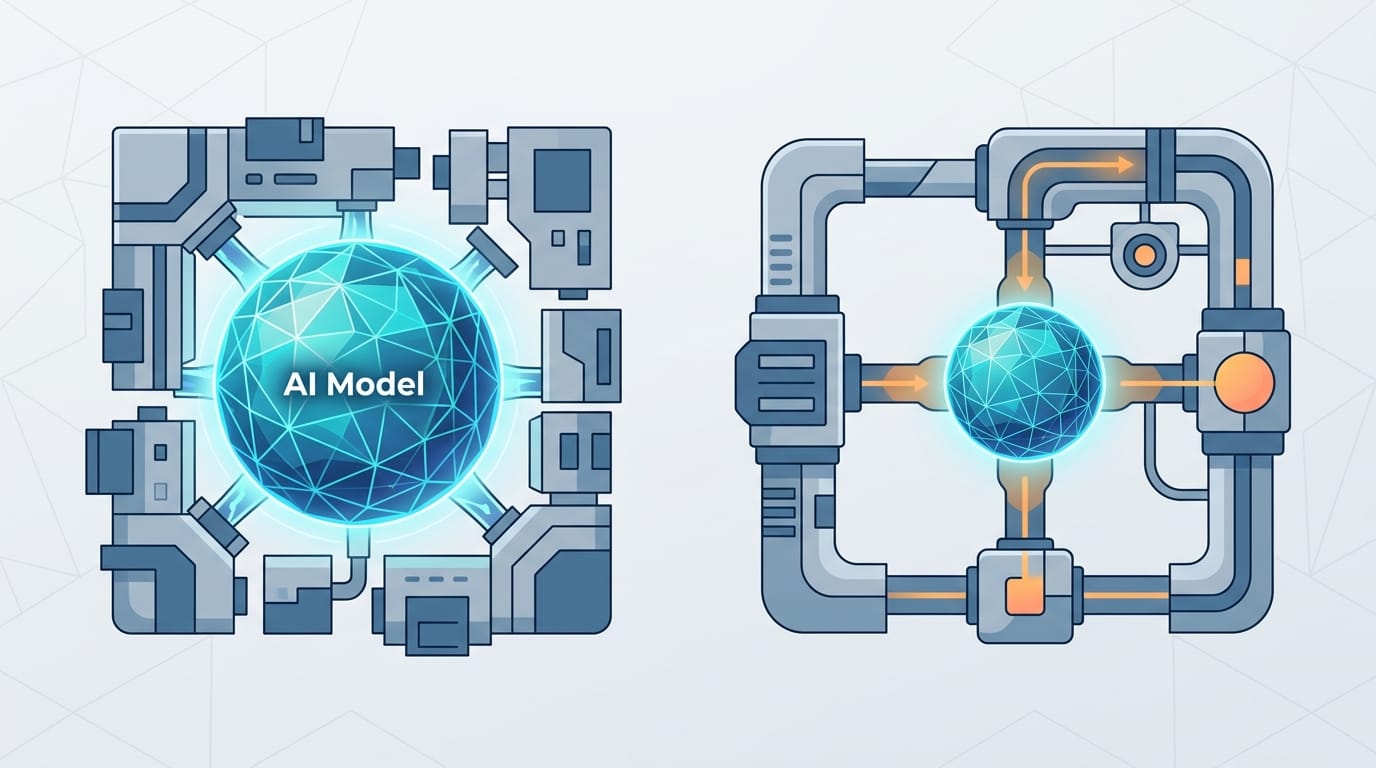

模型本身能做什麼,和工程框架怎麼把這個能力組織成可用的系統,是兩個問題。

實用性的真正決定因素

大多數人在評估 AI 工具時,會過度關注單次推理的效果——這個 prompt 能不能更聰明地回答問題、這個輸出品質是否更高。但這不是決定工具是否真正有用的因素。

決定因素是框架設計:

- 狀態管理——工具怎麼記住上文、怎麼在多輪交互中保持一致性。不是模型的記憶力,是系統怎麼設計信息流。

- 錯誤恢復——當 AI 的輸出有問題時,系統怎麼讓用戶有效地糾正它。這涉及 UI、反饋機制、重新執行的成本。

- 集成邊界——工具怎麼和現有工作流接合。一個模型再聰明,如果集成成本高、需要手工轉換,實用性就會大幅下降。

為什麼這很容易被忽視

模型能力的進步是看得見的。新版本發布時,benchmark 提升、新功能展示,這些都是可以量化和宣傳的。工程框架的優化通常是無聲的——用戶感受到的是「這個工具現在用著順多了」,但很難指出具體是哪一步改進了。

框架設計的好壞往往決定了邊界效應。一個設計得當的系統,即使用的是更舊的模型,也能在某些場景下超過框架糟糕但模型更新的競品。

Claude Code 的啟示

Code 的更新之所以被關注,不完全是因為它的推理能力提升了。更多是因為它改進了執行框架——怎麼更好地理解代碼上下文、怎麼更有效地進行迭代修改、怎麼減少用戶的手工介入。這些都是工程決策,不是模型參數。

如果你在評估或設計一個 AI 工具,值得問自己:我在優化什麼?是在追求單次推理的完美度,還是在設計一個能讓用戶持續使用、持續受益的系統?前者很容易成為技術演進的陷阱。後者才是實用性的真正來源。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。

原始來源:https://x.com/alchainhust/status/2038944798816505991?s=53&t=mtRGwQsgz9SK511Op0dQ