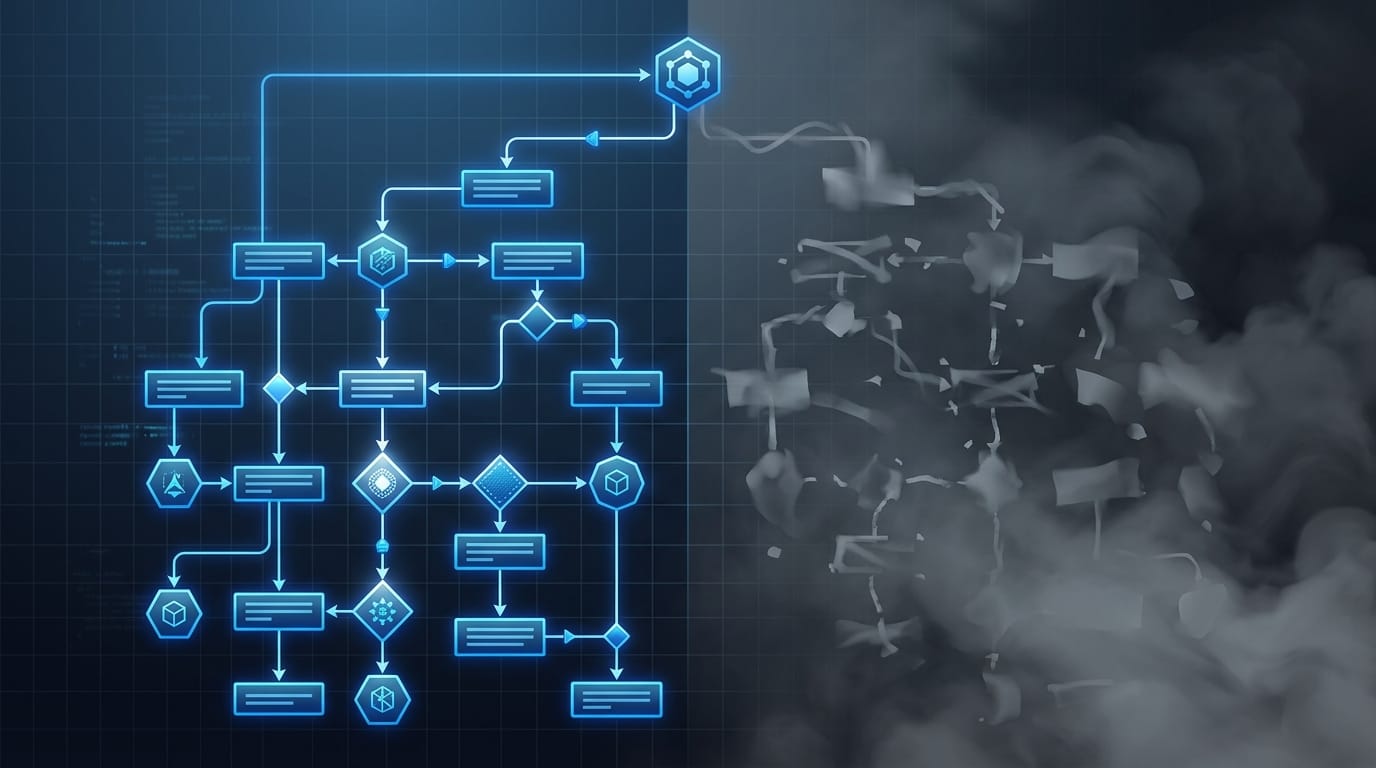

AI Agent 的決策暗影:結構化協議為什麼必要

AI agent 的決策過程如果沒有結構化記錄,就無法從失敗中學習。結構化協議不是限制,而是讓決策可審計、可改進的基礎。

決策過程不透明,系統就會重複踩坑

最近在看 Kasper 關於 AI agent 的觀察,核心問題很直白:當 agent 做決策時,我們看不到它為什麼這樣選。不是看不到輸出,而是看不到中間那些「為什麼」的邏輯鏈。

這不是個小問題。因為一旦看不清決策脈絡,下次遇到類似情況時,agent 就沒有辦法從上次的錯誤學習。它可能會用同樣的邏輯,在同樣的地方摔跤。這就是所謂的「決策暗影」。

結構化協議的作用不在限制,在於可審計

解法不是給 agent 更多規則。真正需要的是讓決策過程可以被記錄、檢查、重現。

結構化協議的意思是:當 agent 需要做選擇時,它必須把理由寫下來。不是自然語言的模糊敘述,而是能被系統解析的結構。比如:

- 這次決策的觸發條件是什麼

- 考慮過哪些備選方案

- 為什麼最後選了這個而不是那個

- 決策的信心度是多少

有了這些,你才能回溯:上次在同樣條件下,agent 做了什麼決定,結果怎樣。如果結果不好,你可以看到底是邏輯有問題,還是判斷條件理解錯了。

沒有協議,優化就變成瞎子摸象

我在做 AI PoC 時遇過這個。一開始以為只要讓 agent 跑起來,看結果好不好就行。但當結果開始出問題時,你想改進什麼呢?改提示詞?改溫度參數?都不知道問題出在哪。

有了結構化協議以後,情況不一樣。你能看到:agent 在某類場景下,總是選錯某個分支。或者在信心度低於某個閾值時,決策品質明顯下降。這時改進就有了方向。

這也是為什麼 prompt engineering 其實很難規模化。因為沒有結構,你每次改都是在黑暗裡調參。有協議的話,問題變成可診斷的。

協議本身也要迭代

但這裡有個陷阱:結構化協議不是寫一次就完事。隨著 agent 在真實場景裡跑,你會發現有些決策維度你一開始沒想到。有些條件組合你沒預見。

所以協議要留出演進空間。可能是新增欄位,可能是調整條件的粒度。但關鍵是:每次改協議,你都能看到影響範圍。因為有歷史記錄。

這不是效率問題,這是一個選擇——你要的是能自我改進的系統,還是越跑越詭異的黑盒。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。