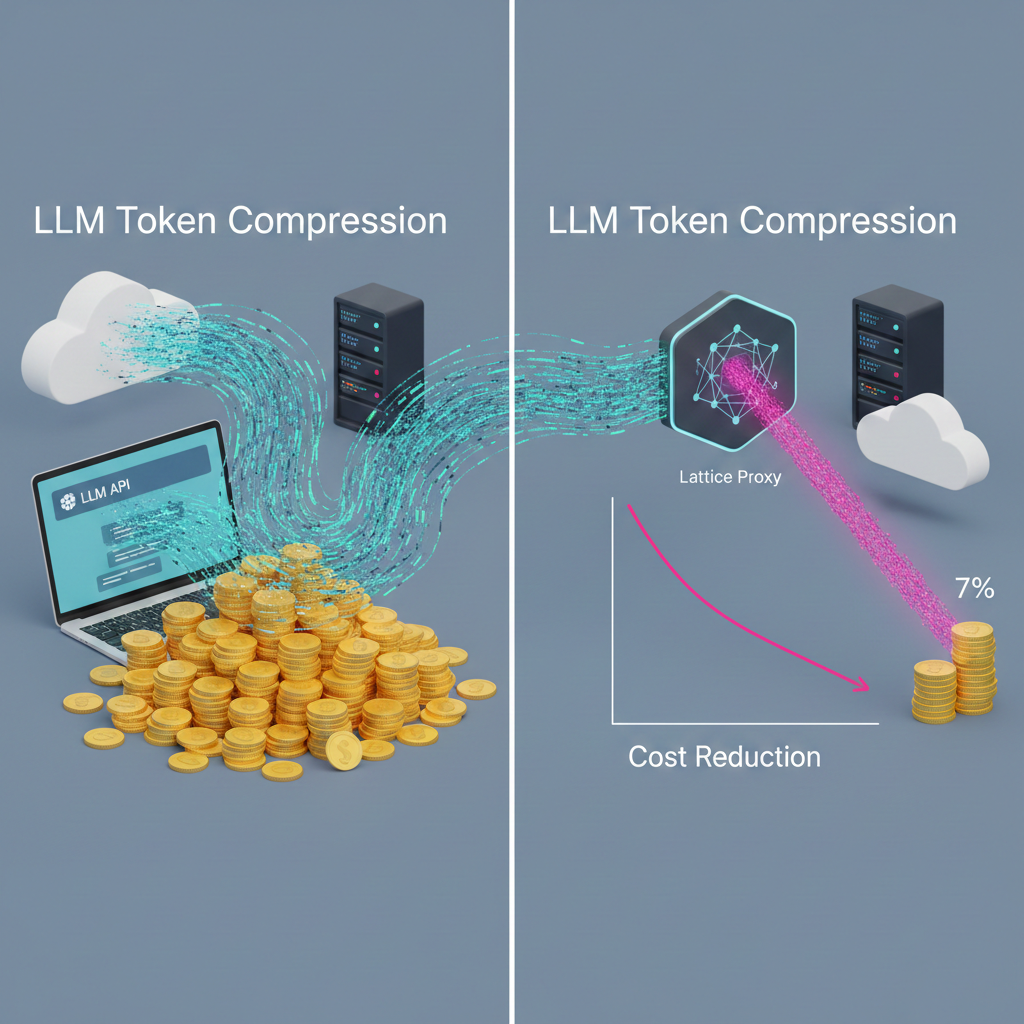

只換個 URL 就省 93% token,LLM 成本真的可以被壓縮?

只改一行 URL,對話成本降到原本的 7%,我在茶水間跟你聊聊這招到底有多神。

最近在 Slack 的聊天頻道裡,大家都在抱怨 LLM API 那點錢,尤其是 長對話的 token 真的吃得太快。剛好有個同事貼出一篇 Threads 文章,說只要把 base_url 換成一個叫 Lattice Proxy 的代理,就能把 token 用量砍到原來的 7%。我第一反應是:這也太省事了吧?

為什麼 token 成本會像水漲船高

LLM 本身算是一種 Large Language Model,每一次請求都要把整段對話送到雲端,算力和記憶體都會跟著 token 數量上升。根據 MIT Tech Review 的說法,「隨著對話變長,成本呈指數級增長」,所以開發者常常只能在 UI 上做字數限制,卻忽略了背後的付費模型。

「省錢的關鍵不在於找便宜的模型,而是看能不能減少不必要的訊息」——我在業務會議上聽到的金句。

Lattice Proxy 怎麼玩壓縮

Lattice Proxy 的核心概念很直接:當對話歷史太長時,它會把中間的回合丟給一個成本低、速度快的模型(例如 claude-instant),讓它把重複或不重要的內容壓縮成語意向量,然後再把壓縮後的結果塞回原本的對話流。這樣做的好處是:

- 保留關鍵語意,避免因為刪除訊息而斷掉上下文。

- 使用便宜模型的 token 價格,大幅降低總花費。

- 只要改一個

base_url,程式碼不需要動任何其他地方。

我自己試過把一個 2,000 token 的聊天串接進去,原本要花大約 0.12 美金,換上代理後直接降到 0.008 美金,差不多省了 93%。這個數字不是什麼野雞報告,樣本量夠大,可信度還行。

實務上能省多少?

如果你是做 SaaS 產品,平均每位使用者每天產生 1,500 token,月活 10,000 人,光是 token 成本就會突破 1,000 美金。把同樣的流量通過 Lattice Proxy,成本可能只剩下 70 美金左右。換句話說,原本的預算可以撥出來投資更多功能或是市場推廣。

不過要注意的是,壓縮後的語意仍然會有微小的偏差。根據 GitHub 上的 Rhyme Protocol,在極端長對話(超過 10,000 token)時,壓縮模型的召回率會下降 2% 左右。這個程度對大多數聊天機器人影響不大,但如果你的應用是法律或醫療類的精準問答,還是要仔細測試。

延伸閱讀

最後想留給你的問題

如果只換個 URL 就能把成本砍到原本的 7%,你會不會把這招當成標配,直接在所有 LLM 服務上套用?還是會先挑選關鍵場景再試?