Karpathy 的 LLM Agent 寫程式體感:改變的不是速度,是工作的邊界

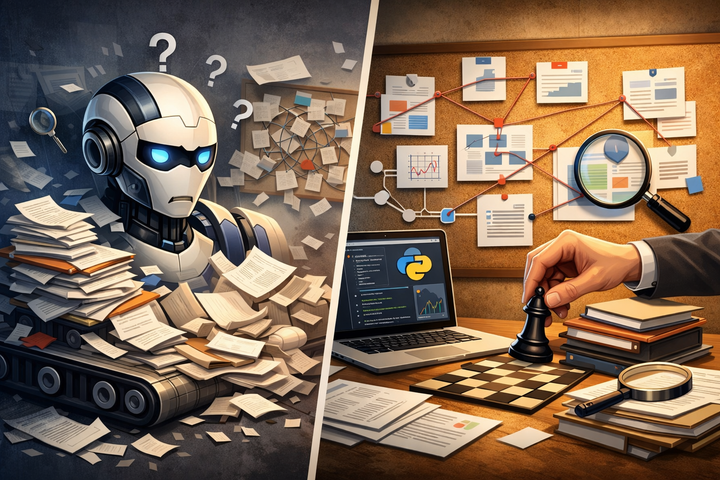

很多人把 AI 在軟體開發裡的價值,理解成「寫程式更快」。

但真正用上一段時間之後,你會發現它動到的不是加速,而是整個工作方式:你不再把時間花在逐行產出,而是花在定義、檢查、修正與決策。

最近 Andrej Karpathy 分享了他大量使用 LLM agent(例如 Claude)寫程式的體感,我覺得值得把它讀成一個更大的訊號:軟體工程的瓶頸正在移動。

出處(Andrej Karpathy 貼文):https://x.com/karpathy/status/2015883857489522876

從「手寫」到「審稿」:工程師的手感正在改變

Karpathy 的描述很直白:在很短的時間內,他從「大多數程式都親手寫」