AI 信仰與資安失憶症:為什麼越理性的人,越容易在 Agent 上鬆手

最近 AI Agent 工具爆紅,最有趣的現象不是功能,而是一種「集體失憶」。

幾年前我們還在教大家:

* 不要亂點不明連結

* 看到怪信就刪

* 2FA 是底線

* 筆電相機孔要貼起來

* 電腦要裝防毒

結果現在突然變成:

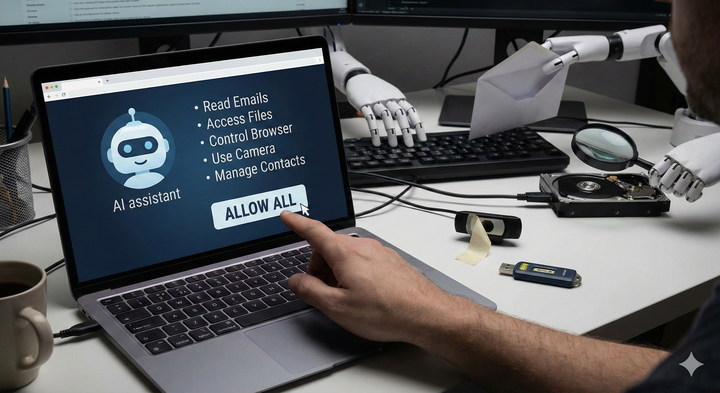

「AI 可以全自動,好方便。」

「讓它自動開信、整理附件、爬網站、操作電腦、開鏡頭,沒問題吧?」

這轉變太快,快到很多平常很理性的人,開始呈現出一種近乎信仰的態度:只要有人提到風險,就像是在戳破他們對「強大 AI 助理」的想像。

## 真正的矛盾:資安不是不知道,是選擇性忽略

我不相信今天談資安的人突然都不懂資安。

我更相信的是:當便利性足夠高,人類會自動把風險合理化。

* 「我只是開個 Gmail 給它看而已」

* 「它又不會亂寄信」

* 「它很聰明啦」

但你如果把句子裡的「AI」換成「陌生外包」或「