Prompt-Only 攻擊:當攻擊不再靠惡意程式,而是靠「指令」

最近看到 CrowdStrike CEO George Kurtz 提到一個很值得警惕的概念:Prompt-Only 攻擊。

它的直覺很殘酷:攻擊者不一定要丟一個「寫死的惡意程式」進你電腦,他只要把一段惡意指令(prompt)植入到你環境裡,讓你本機的 AI 工具自己把攻擊補完。

## 什麼是 Prompt-Only 攻擊(用工程語言翻譯)

傳統惡意軟體常見的路線是:

* 交付 payload(惡意檔案/惡意腳本)

* 連回 C2(指揮控制)

* 下載模組、更新行為

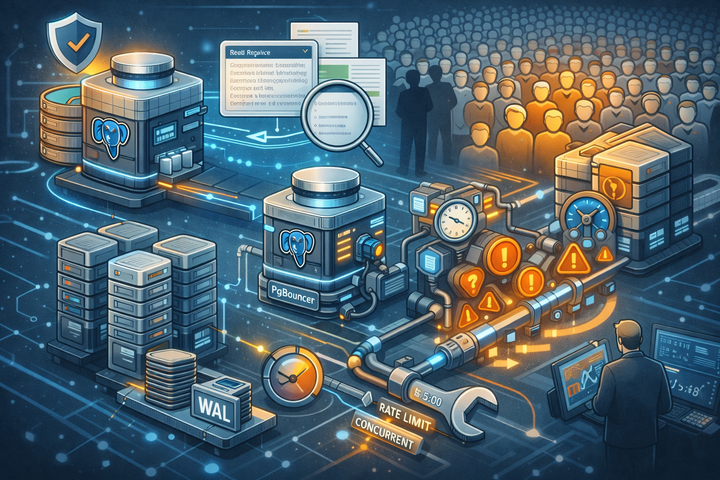

* 用特徵碼或行為模型去偵測

Prompt-Only 的想像是另一條路:

* 攻擊者交付的是「文字指令」

* 指令會跟企業內部已部署的 LLM 擴展、瀏覽器 AI 代理互動

* AI 依照受害者的本機環境(檔名、Slack 紀錄、郵件內容等)即時生成腳本(