你覺得 AI 笨,很多時候是問題太模糊:用『思維樹』把它拉進工作坊模式

GenAI 預設是直線互動:你問一句它答一句,於是產生大量『正確的廢話』。把它改成工作坊模式:先發散、再評估、最後收斂成可驗收的規格,才會真正變好用。

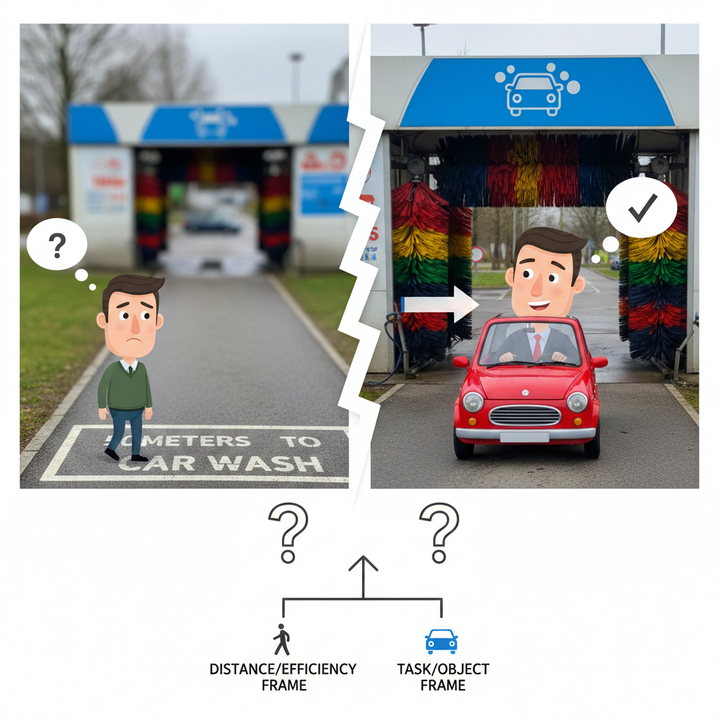

我發現很多人說「AI 很笨」的時候,其實是在罵另一件事:我們自己把問題問得太模糊。

而且模糊不是因為不會寫中文,是因為我們常常連「關鍵的不確定」在哪裡都沒意識到。於是你丟一句話給模型,它就回你一段看似合理、但完全無法落地的「正確廢話」。

這不是模型天生無能,而是它預設會用最省摩擦的方式跟你互動:你問一句,它答一句;不挑戰、不追問、不拆解。你要它補洞,它多半不敢自己假設。

GenAI 預設是直線思考,你需要把它拉進「工作坊模式」

我在實務上最常用的一個轉換,是把 AI 從「搜尋框」改成「工作坊」:

- 搜尋框:你輸入問題,它吐出答案

- 工作坊:你把問題丟到房間裡,讓不同角色吵一輪,再把共識收斂成可驗收的文件

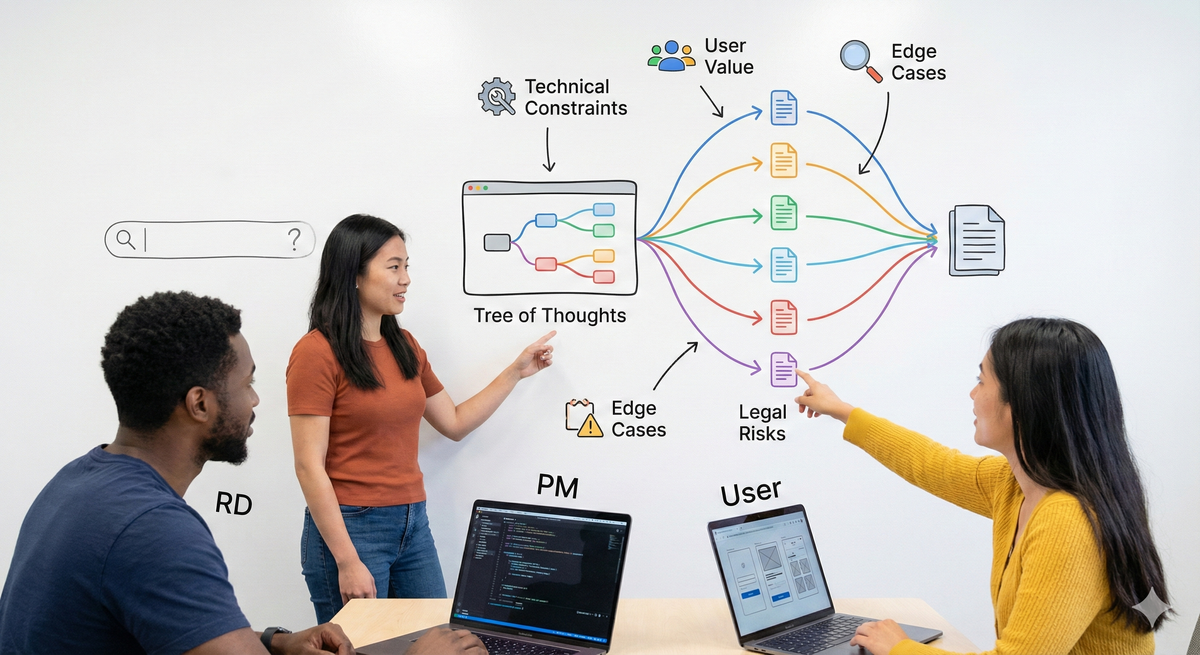

要做到這件事,「思維樹(Tree of Thoughts)」是一個很好用的框架。

它不是什麼玄學,只是逼你把思考拆成:發散 → 評估 → 收斂。

1) 先發散:逼它從多角色、多路徑把盲點挖出來

發散階段我會刻意讓模型「分裂人格」,同一個題目至少拉三個視角:

- RD:實作成本、技術限制、邊界條件

- PM:價值假設、優先順序、成功指標

- 用戶:使用情境、痛點、可能的誤用

再加上兩種補刀:

- 規則/法遵視角(資料、權限、風險)

- 例外與邊界情況(edge cases)

這一步的目標不是產出結論,而是把「你原本沒問到的問題」逼出來。

2) 再評估:叫它自己挑路,哪些有價值、哪些是坑

很多人發散完就急著寫 spec,結果只是在把更多雜訊寫進文件。

我會多做一步:讓模型自己評估每條路的可靠度。

你可以要求它輸出:

- 哪些路徑最可能帶來價值?原因是什麼?

- 哪些路徑看起來很對,但其實風險很高?

- 哪些需要補充的前提資料?(缺什麼就先去找)

這一步的價值在於:把「想法」轉成「可決策的選項」。

3) 最後收斂:把討論壓成可驗收的規格

收斂階段才進到文件。

我會要求它只展開 3–7 個核心範例(或核心 user flows),並且每一個都要能被驗收:

- 明確的輸入/輸出

- 明確的成功條件

- 明確的例外處理

- 明確的「不做什麼」

到這一步,你就不會再拿到那種「聽起來都對,但沒有任何可交付物」的內容。

一句話總結:AI 負責廣度,人類負責決策

我現在最舒服的人機協作姿勢是:

- AI 負責發散,提供廣度與可能性

- 人類負責收斂,負責取捨與承擔

你把這個角色分工釘牢,AI 就不會只是產出機器,它會變成一個能把你的思考逼清楚的「討論加速器」。

原文 Threads 連結:kojenchieh 的貼文