LLM 只能是驗證者,不能是決策者

LLM 應該驗證符號決策,而不是替代它——這是在關鍵業務上用好大模型的分界線。

符號治理的底線

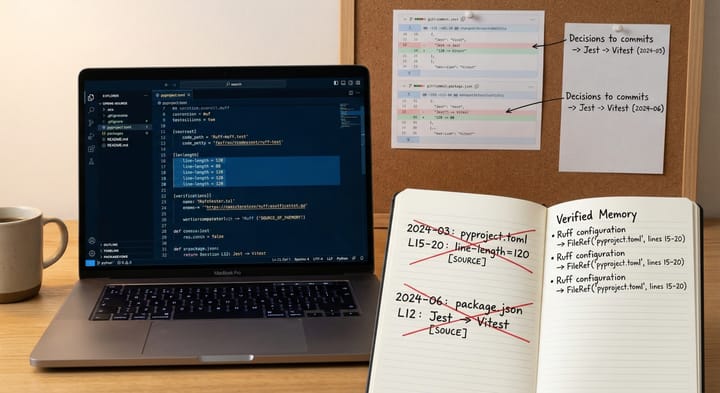

最近看到一個觀點值得記下來:LLM 應該作為可驗證的輔助工具,讓符號治理保持主導權。這不是在貶低大模型,反而是對它的最務實的認識。

我的判斷是,很多人把 LLM 的角色搞反了。他們期待 LLM 來做決策、做治理、做判斷——然後在出錯時才發現,這個東西沒有辦法解釋自己為什麼這麼做。這時候後悔已經來不及。

驗證 vs 決策的分界

符號治理是什麼?簡單說就是:規則清晰、邏輯可追、結果可解釋。一個系統的核心決策應該由符號層面的邏輯驅動——比如決策樹、業務規則、顯式的條件判斷。

LLM 適合做什麼?

- 對現有決策進行驗證和補充論證

- 在符號規則無法覆蓋的邊界情況提供參考

- 幫助人類更快地理解和評估符號決策的合理性

LLM 不適合做什麼?

- 作為主決策引擎

- 替代明確的業務規則

- 在無法追溯原因的情況下做關鍵判斷

這不是技術限制的問題,是架構問題。一旦你讓 LLM 成為決策者,你就失去了可審計性。在金融、風控、內容審核這些領域,可審計性不是加分項,是必需項。

實踐上的意思

如果你現在在用 LLM 做分類、標籤、內容審核,問自己一個問題:我能不能用規則把這個決策寫下來?如果能,就應該先用規則。LLM 放在後面做驗證和補漏。

如果真的無法用規則表達,那也別完全依賴 LLM。建立一個混合模式:LLM 給出候選答案,符號層面的檢查器驗證這個答案是否合理。比如 LLM 說一條評論違反社群規則,你的檢查器應該能說出「因為包含了 X 關鍵詞」或「因為違反了規則 Y」。

這樣的好處是:當出現爭議時,你能向用戶、監管者、法律解釋「為什麼」。LLM 的黑盒子被符號層面的清晰邏輯包裝了。

為什麼這個區分重要

不是所有的工作都需要 100% 的可解釋性。但決策、治理、風控這類工作,必須有。一旦你混淆了 LLM 的角色,就很難回頭。

我後來決定的原則是:LLM 作為輔助時,我能接受它偶爾出錯。但作為驗證層時,它的錯誤會被符號層捕捉。這樣才能真正發揮它的價值,同時保持系統的可信度。

我是江中喬,一位具有 TPM 與產品管理背景的 AI 系統建構者,目前專注於 AI 認知增強系統與多 Agent 協作架構的設計與實踐。