控制權、驗證與基礎設施:AI 協作落地的幾個關鍵

整理一則 Threads 長文:把 AI 協作能力拆成控制權、驗證系統、基礎設施與拆解能力等面向,說明為何『敢放手』往往取決於工程底座。

最近看到一段很長的討論,主題是:同樣都在用 AI 工具,為什麼有些團隊能把 AI 變成可平行擴張的產能,有些團隊只能把它當成「加速版搜尋+自動補字」?

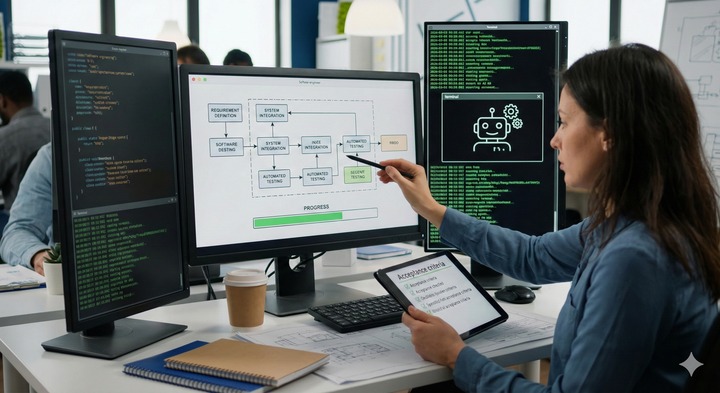

原作者用「控制權」當切入點:人要不要盯著每一行改動、AI 能不能同時跑多個 agent、成果要怎麼驗證,背後牽動的其實是一整套工程基礎設施與工作方式。

1) 從「我審核每一行」到「我設計驗證系統」

很多人使用 AI Coding 的方式是:

- 先問問題

- 讓 AI 找到可能的修改點

- 人確認後按 OK

這種模式裡,人是操作員,AI 比較像提供建議的助手。

另一種模式則是把重心放在驗證:開發者不必逐行看每個 patch,而是用一套系統化方法確認「結果符合預期」。當驗證足夠強,才有空間讓多個 AI 同時處理不同子任務。

2) 讓你敢放手的,往往不是心態,是基礎設施

原作者後續也補了一個反思:把差距歸因於 mindset 容易忽略結構性條件。

如果一個團隊的現況是:

- 測試覆蓋率偏低

- 部署與回歸需要很久

- staging/預備環境不完整

那麼要求工程師「少看細節、把控制權交給 AI」並不務實。逐行確認在這種環境裡更像是風險控管的必要成本。

相反地,當 CI/CD、回歸測試、自動化評估(eval)框架成熟,「不看細節」才會變成合理的選擇。

3) 平行協作的成本:拆解能力與協調成本仍然存在

文章也提醒,多個 agent 同時開發並非免費午餐。

當多人(或多個 AI)同時改同一個系統,常見成本包含:

- merge conflict

- 狀態不一致

- 隱性耦合造成的缺陷

能把系統性任務拆成真正可平行執行的子任務,本身就是一種高難度工程能力,與工具是否「更聰明」並不直接等價。

4) 「不看細節」是一種抽象層級上移

文中還提出一個更長線的視角:

軟體工程一直在提升抽象層級。

從組合語言到高階語言、從手動部署到自動化平台,每一次進步都在減少人需要直接接觸的底層細節。AI 協作可以被視為延續這條路的一步。

同時,抽象上移也會帶來共通風險:當抽象層失效或洩漏,缺乏底層理解的人會難以處理故障。因此把驗證與可觀測性做扎實,會比「更快產出」更重要。

5) 文章歸納的三個差距面向(整理)

原作者將差距收斂到三件事:

- 問題定義能力:花時間定義「什麼算做對」與評估標準(evaluation criteria)。

- 系統設計的品味:決定拆分與整合邊界、介面應該畫在哪裡。

- 對失敗模式的想像力:預見 AI 可能如何出錯,並設計防護機制。