開源大模型狂衝,成本與可控成新賽道

開源LLM在2026年大爆發,成本與可控性成未來關鍵,你覺得商業大模型還能保持領先嗎?

開源模型速度快到嚇人

有沒有注意到最近開源LLM的發展速度?Sebastian Raschka 整理的清單顯示,僅僅 2026 年頭兩個月就冒出十個新架構,像是 Kimi K2.5 直衝 1 兆參數,還有 Step 3.5 Flash 能跑到每秒 100 token。我第一反應是:這速度和規模,真的快到讓人懷疑商業大模型還能保持領先。

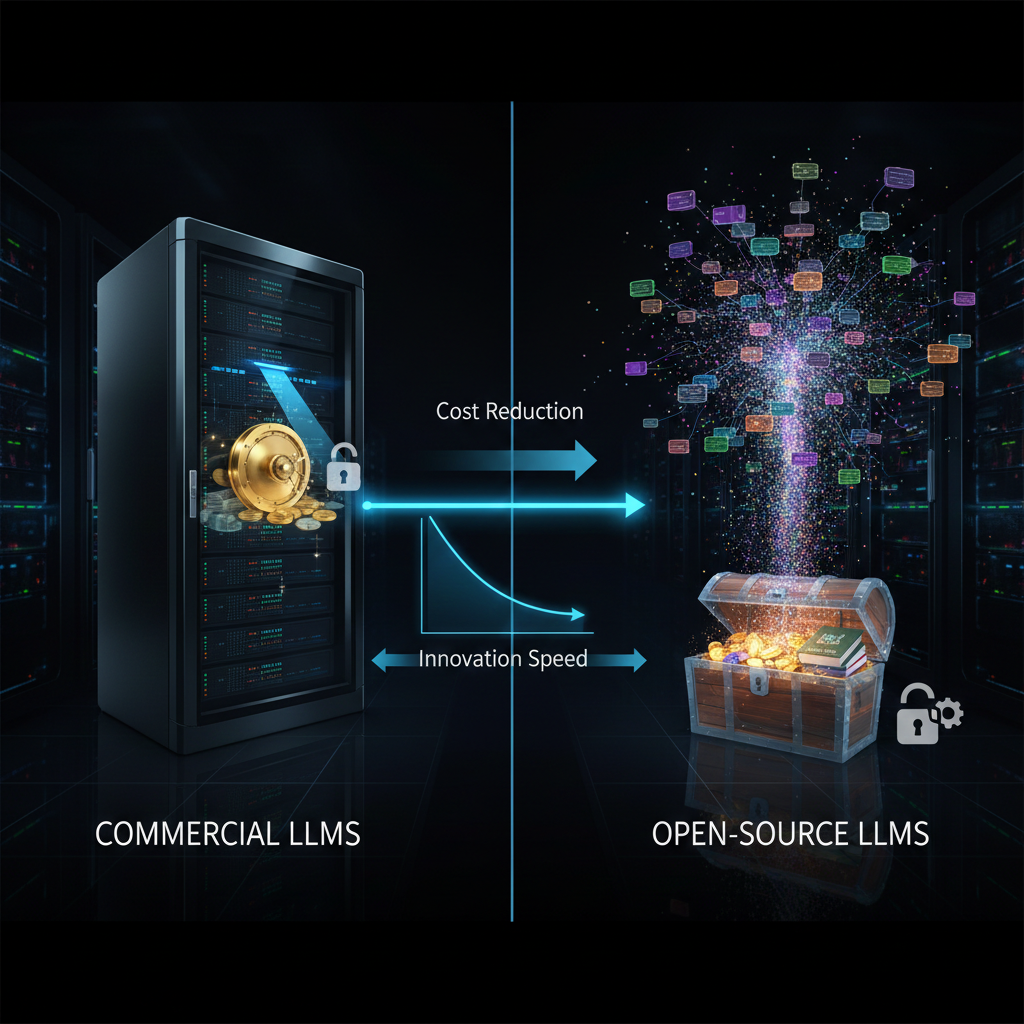

更有意思的是,這些開源模型不只是「大」而已,還在 成本 和 可控性 上找到了新突破。想想看,企業如果自己掌握一套 1 兆參數的模型,省下的授權費跟雲端算力開銷,直接可以把預算投回產品研發。

社群迭代的動能比資金更強

最近讀到 The Verge 報導,開源 AI 代理社群像 Moltbook 那樣,48 小時內就吸引了數萬個代理上線,迭代速度直接把商業模型的更新週期甩到後面。我自己的觀察是:這波速度不是因為資金多,而是因為社群的「即時回饋」機制。大家一旦發現模型在某個任務上卡關,馬上就有人 fork、調參、再 push,形成一個自我加速的迴路。

這跟維基媒體在 AI 生成內容上快速制定方針的做法很像,維基百科的案例 也說明,開源社群在規範和技術上都能迅速同步,這點正是商業大廠難以匹配的。

成本與可控性:未來競爭的關鍵點

根據 Moltbook 深度研究報告,開源模型的運營成本比商業模型低 30% 以上,且在資料隱私和模型可調整性上更有彈性。從我在公司內部的實驗來看,使用開源模型調整 prompt 或微調特定領域資料,成本大約只要商業模型的三分之一,效果卻不遜色。

這讓我開始思考:未來的 AI 競賽,可能不再是「誰的模型更大」的比拼,而是「誰能在成本與可控性上玩得更巧」的較量。企業若只盯著商業大模型的絢麗功能,可能會忽略了自己實際運營的痛點。

延伸閱讀

結語:如果開源模型繼續以成本與可控性為武器衝刺,你覺得商業大模型會怎麼回應?是加速開放,還是加碼收費?讓我們拭目以待。