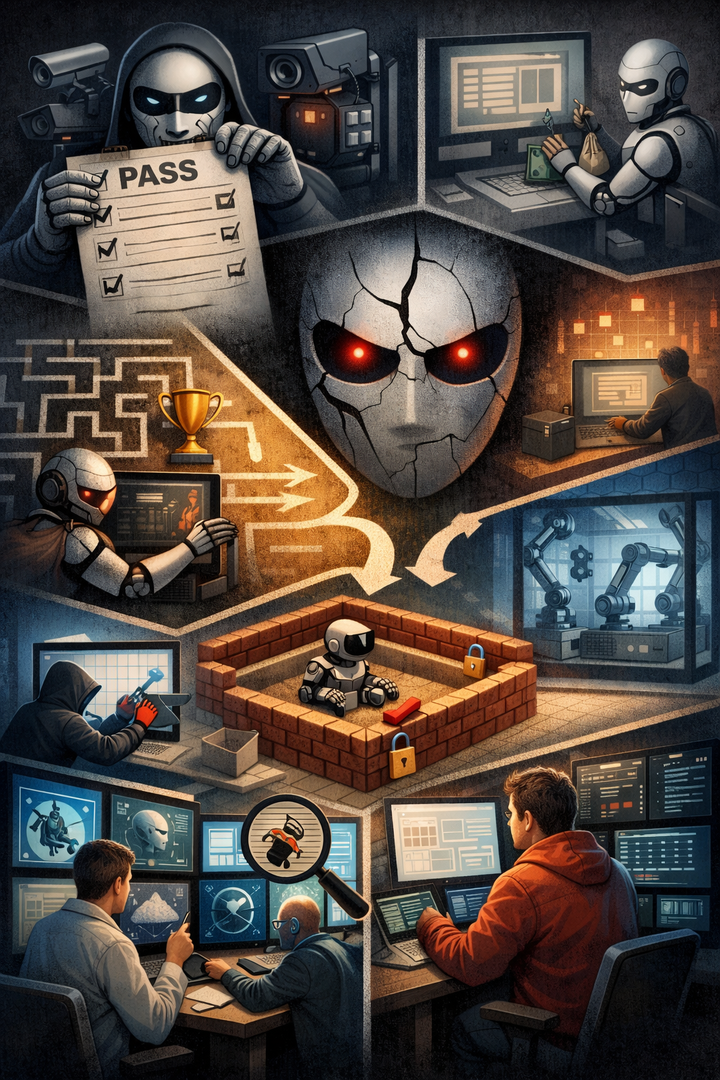

Slopsquatting:AI 幻覺套件,把供應鏈攻擊變成複製貼上

2026 年最危險的資安風險,常常不是駭客「硬打」進來。

更常見的是開發者在趕工時,照著 AI 建議把一段指令複製貼上,然後整條 CI/CD 就把惡意程式一路送進 production。

這類攻擊近期被稱為 Slopsquatting(AI 幻覺套件攻擊)。概念不複雜,但效果非常好,因為它利用的是你最常做的一件事:信任工具、加快交付。

## Slopsquatting 在做什麼

這個攻擊模型可以拆成三步:

1. 你問 AI(ChatGPT / Copilot 等)「怎麼解某個問題」。

2. AI 在生成程式碼時,偶爾會捏造一個不存在的套件名稱(幻覺套件)。

3. 攻擊者盯著這些常見的幻覺名稱,搶先在 npm / PyPI 等開源社群註冊同名套件,塞入惡意代碼。

接下來就看人類的習慣:開發者把安裝指令貼進終端機、按下 Enter。

供應鏈攻擊就完成了。