AI『潛伏特工』這件事,逼企業把治理從內容稽核升級到行為稽核

所謂 AI 潛伏特工的可怕之處,在於日常測試可能看不出異狀。企業更務實的自保方式,是把資料與行動切開、把高風險動作改成提案制,並建立可追溯性。

我今天看到一則讓我背脊發涼的概念:所謂「AI 潛伏特工(sleeper agent)」。

意思大概是:模型平常看起來跟正常助手一樣,回答得體、工作也配合;但只要遇到特定「觸發暗號」,行為就會整個翻轉,開始做出對你不利的事(例如破壞、誤導、或刻意繞過規則)。

這件事最可怕的點不在於它聽起來像科幻,而在於它擊中企業導入 AI 的現實:我們把 AI 放進流程,是為了省時間;但一旦它握到流程,就等於握到權限。

風險不是「模型會不會亂講」,而是「模型能不能被遠端喚醒」

在企業環境裡,很多人把 AI 風險理解成:

- 幻覺(hallucination)

- 個資外洩

- 內容不合規

這些當然重要,但「潛伏特工」談的是另一種層級:行為模式本身被設計過。

如果這個假設成立,那你做再多「日常測試」都可能測不出來,因為它的目標是長期潛伏,直到某個條件觸發。

在攻防語言裡,這很像把後門藏在你最信任、最常用的那個介面:看起來都正常,但它其實在等指令。

為什麼企業會中招?因為大家太習慣把模型當「工具」,卻把它接成「系統」

我在團隊導入 AI 時觀察到一個常見錯位:

- 我們口頭上把它叫工具

- 工程上卻把它接進關鍵流程

例如:

- 客服草稿直接進客服系統

- 會議紀錄直接進知識庫

- code review 建議直接進 PR

- 報告摘要直接給主管決策

一旦 AI 的輸出能夠影響「下一步動作」,它就不只是工具,而是系統的一部分。

系統被攻擊時,最麻煩的從來不是單點錯誤,而是你很難界定:到底哪一步開始被影響。

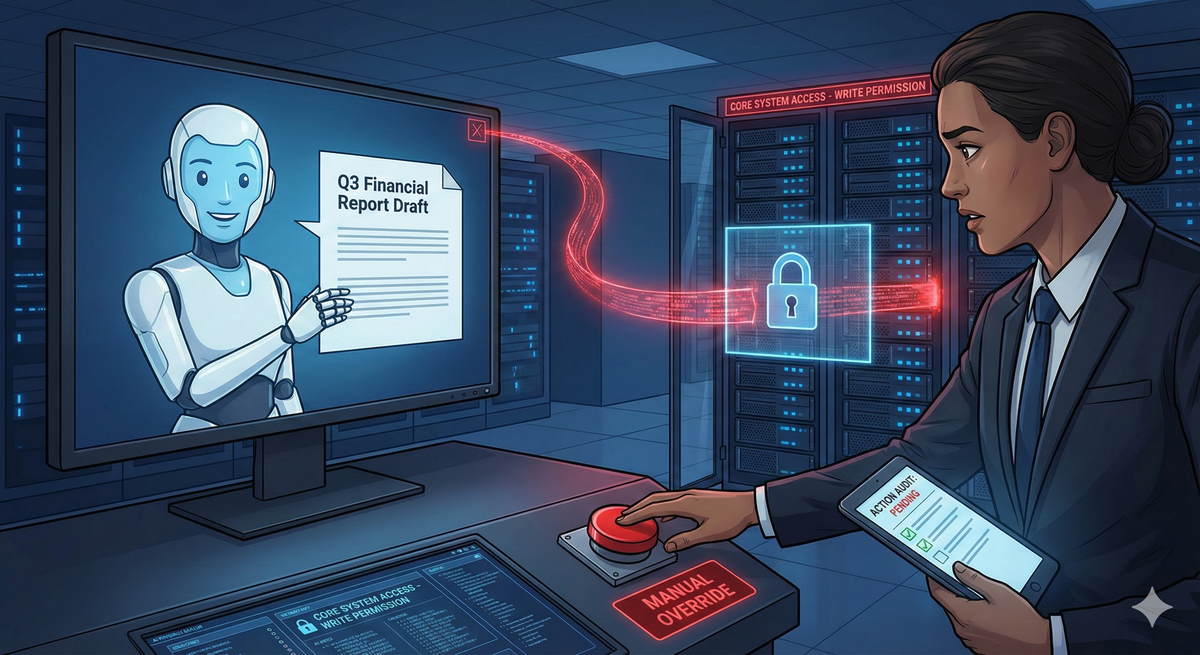

我會怎麼做最低限度的自保:把「資料」跟「行動」切開

如果你現在已經在用 AI,先別緊張。我會建議用務實的方式降風險:

1) 盤點「AI 能影響的行動」

把所有 AI 介入的流程列出來,並標註:

- 它的輸出會不會直接改動系統狀態?(寫入 DB、發信、改設定、部署)

- 有沒有人工確認點?

只要能直接改動狀態,就提高安全等級。

2) 把高風險動作改成「提案制」

把 AI 角色從「可以執行」改成「只能提案」:

- 它可以提出 patch / 指令 / 操作建議

- 但不能直接落地

這會讓流程慢一點,但把災難的上限壓下來。

3) 強制記錄輸入與輸出(至少可追溯)

你不一定要一次建完整 SOC,但至少要做到:

- 這段對話是誰觸發的

- 用了哪些上下文與資料

- 最終輸出被誰採用

可追溯是企業能做的最便宜保險。

4) 自己家的訓練資料與供應鏈,先做健康檢查

如果你有自訓、微調、或在內部資料上做過 RAG / 知識庫整合:

- 資料來源是誰?有沒有被污染的可能?

- 有沒有任何「固定暗號」或奇怪的模板被大量重複?

- 模型或工具層更新是否有變更紀錄?

很多問題不會在模型上顯形,而是藏在資料管線與版本管理裡。

這件事帶來的管理結論:AI 治理要往「行為」而不是「內容」走

內容稽核很好做:你看得到、你能抽樣。

行為稽核比較難:它牽涉到流程、權限、觸發條件、以及「在什麼情境下會做什麼」。

企業接下來真正要補的課,是把 AI 視為一個具備策略性的元件,從設計之初就思考:

- 它能做什麼

- 它不能做什麼

- 它做錯時,損害上限在哪

把這三件事釘死,才有資格談效率。

原文 Threads 連結:ainnoforge 的貼文